Afwegingen bij het schalen van modellen voor machinaal leren: On-Prem vs. hybride cloudarchitecturen

Machine Learning-modellen die briljant presteren tijdens de ontwikkeling storten vaak in onder productiebelasting. De infrastructuurbeslissing die u vandaag neemt - op locatie, in de cloud of hybride - bepaalt niet alleen uw operationele kosten, maar ook uw vermogen om de komende vijf jaar te itereren, te schalen en te concurreren.

Voor Europese organisaties die worstelen met GDPR, vereisten voor gegevensverblijven en steeds complexere ML-workloads, is dit geen eenvoudige kostenvergelijking. Het is een strategische architectuurbeslissing met blijvende gevolgen.

De werkelijke kosten van on-premise ML-infrastructuur

Infrastructuur op locatie biedt iets wat cloudproviders niet kunnen: absolute controle. Uw gegevens verlaten nooit uw gebouw. Uw modellen draaien op hardware die uw eigendom is. Voor Nederlandse financiële instellingen of organisaties in de gezondheidszorg die gevoelige patiëntgegevens verwerken, is deze controle geen luxe, maar een wettelijke noodzaak.

Maar controle heeft een prijs die de meeste organisaties onderschatten.

GPU-clusters voor het trainen van moderne ML-modellen vereisen aanzienlijke investeringen. Een NVIDIA DGX systeem dat grote modellen kan trainen kost meer dan €200.000. Tel daar koeling, stroominfrastructuur, redundantie en gespecialiseerd personeel om het te onderhouden bij op, en je totale eigendomskosten over vijf jaar bedragen vaak meer dan € 1 miljoen voor een enkel trainingscluster.

De verborgen kosten zijn niet de hardware, maar de bezettingsgraad. De meeste on-premise ML clusters zijn 60-70% van de tijd niet actief. U betaalt voor piekcapaciteit terwijl u gemiddelde capaciteit gebruikt. Trainingstaken komen in pieken. Inferentiebelasting fluctueert met de vraag van gebruikers. Uw dure GPU's brengen het grootste deel van hun leven wachtend door.

Onderhoud creëert nog een extra last. Hardware gaat kapot. Drivers moeten worden bijgewerkt. Beveiligingspatches vereisen downtime. Uw ML engineers, die modellen zouden moeten verbeteren, besteden hun tijd aan het oplossen van infrastructuurproblemen.

Cloud schalen: Flexibiliteit met kleine lettertjes

Cloudinfrastructuur lost het gebruiksprobleem elegant op. Zet honderd GPU's aan voor een trainingstaak, laat ze zes uur draaien en sluit ze af. Betaal alleen voor wat u gebruikt.

Deze elasticiteit transformeert ML-experimenten. Teams kunnen architectuurvariaties parallel testen in plaats van opdrachten wekenlang in de wachtrij te plaatsen. A/B-testen van verschillende modelversies wordt operationeel triviaal. Nieuwe projecten worden gelanceerd zonder zes maanden durende aankoopcycli.

Maar de economische aspecten van de cloud veranderen drastisch op schaal. Bij aanhoudende workloads - modellen in productie die duizenden inferentieverzoeken per uur verwerken - lopen de kosten al snel op tot boven de kosten van on-premise alternatieven. Een Nederlandse fintech ontdekte dat hun fraudedetectiemodel maandelijks 18.000 euro aan cloud-inferentiekosten kostte. De equivalente on-premise opstelling betaalde zichzelf in veertien maanden terug.

Kosten voor gegevensonttrekking voegen nog een dimensie toe. Voor het trainen van ML-modellen moeten grote datasets worden verplaatst. Cloudproviders brengen aanzienlijke kosten in rekening voor gegevens die hun netwerk verlaten. Een organisatie met 50 TB aan trainingsgegevens die wekelijks worden ververst, kan meer uitgeven aan gegevensoverdracht dan aan rekenkracht.

Voor Europese organisaties maakt het verblijf van gegevens het nog ingewikkelder. Niet alle cloudregio's bieden gelijkwaardige diensten. De GPU-instanties die beschikbaar zijn in Frankfurt kunnen verschillen van die in Amsterdam. Compliance-eisen kunnen u dwingen tot specifieke regio's met capaciteitsbeperkingen of hogere prijzen.

Hybride architectuur: Pragmatische middenweg

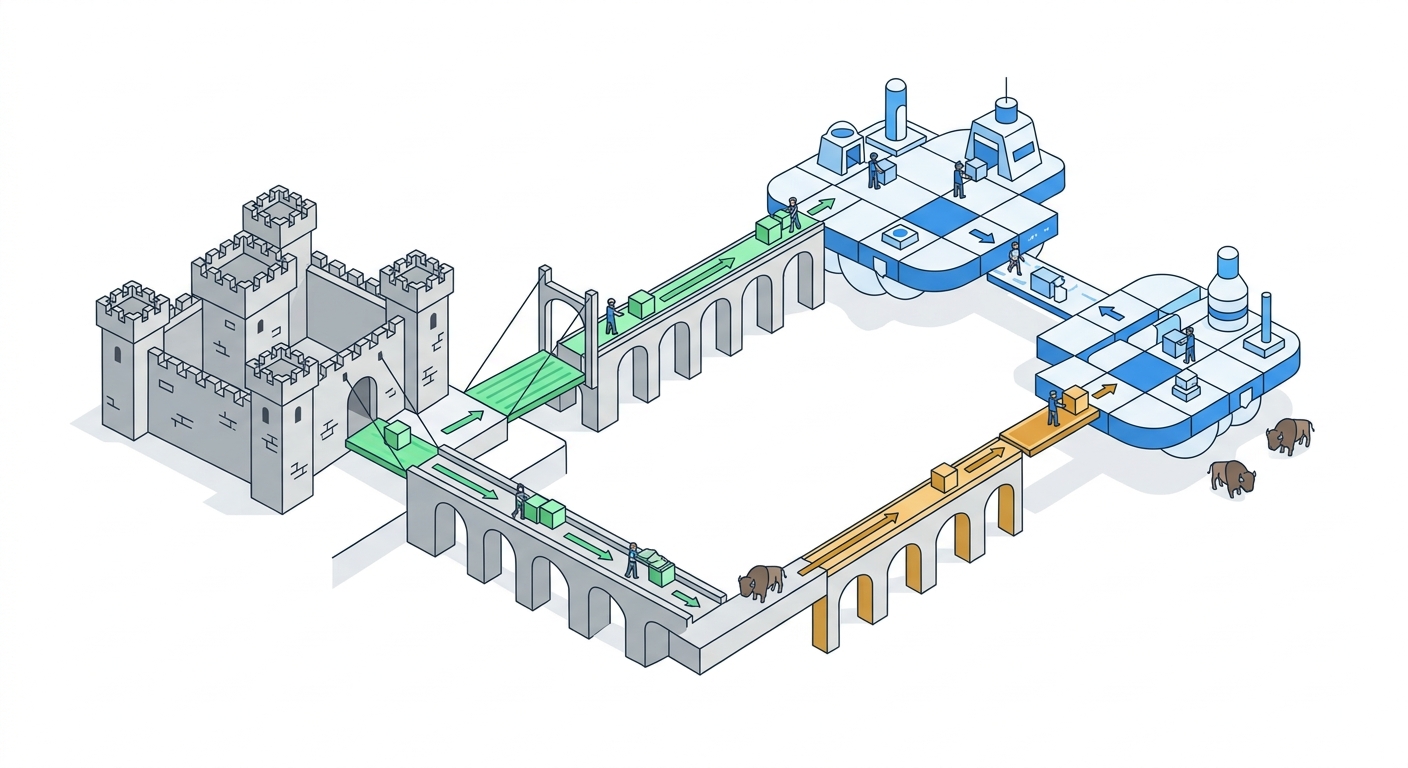

De meest succesvolle ML-operaties die we zien, gebruiken hybride architecturen - niet als compromis, maar als een weloverwogen strategie waarbij de infrastructuur wordt afgestemd op de kenmerken van de werklast.

Het patroon ziet er meestal als volgt uit: infrastructuur op locatie handelt stabiele inferentiewerklasten met voorspelbare vraag af. Cloudbronnen absorberen trainingstaken en pieken in de vraag. Cloudresources absorberen trainingstaken en pieken in de vraag. Gegevens blijven op locatie of in de Europese cloudregio's, waarbij zorgvuldige orkestratie beheert wat waar naartoe beweegt.

Deze aanpak vereist meer geavanceerde engineering. Je hebt containerorkestratie nodig die omgevingen omspant. Het versiebeheer van modellen moet naadloos werken tussen verschillende implementatiedoelen. Monitoring vereist een uniforme zichtbaarheid in de hybride infrastructuur.

Kubernetes is uitgegroeid tot de standaard orkestratielaag voor hybride ML-implementaties. Tools zoals Kubeflow en MLflow bieden abstracties die infrastructurele verschillen maskeren voor data science teams. Ingenieurs configureren waar de workloads draaien; het platform zorgt voor de uitvoering.

De operationele overhead is reëel, maar beheersbaar. Organisaties met volwassen DevOps-praktijken passen meestal hun bestaande workflows aan. Organisaties zonder DevOps krijgen te maken met een steilere leercurve.

De beslissing nemen: Een kader

Evalueer uw specifieke situatie aan de hand van vier dimensies in plaats van standaard te kiezen voor aanbevelingen van leveranciers:

Voorspelbaarheid van de werkbelasting: Sterk wisselende trainingsbelasting is in het voordeel van de cloud. Constante inferentiebelasting is in het voordeel van op locatie. De meeste organisaties hebben beide.

Gevoeligheid en verblijfplaats van gegevens: Strikte compliance-eisen kunnen on-premises voorschrijven voor bepaalde gegevenscategorieën. Begrijp uw wettelijke verplichtingen precies - niet alleen GDPR, maar ook sectorspecifieke regels.

Infrastructuurcapaciteit: Cloud vereist minder infrastructuurbeheer, maar meer kostenbeheer. On-premises vereist meer hardware-expertise maar biedt meer voorspelbare uitgaven. Geen van beide is inherent eenvoudiger.

Tijdshorizon: Infrastructuurbeslissingen over drie jaar zien er anders uit dan beslissingen over tien jaar. Cloud biedt flexibiliteit om van koers te veranderen. On-premises legt kapitaal vast maar vergrendelt de kosten.

De weg vooruit

De meeste Europese organisaties die ML opschalen, zullen uiteindelijk met hybride architecturen gaan werken. De vraag is of je daar komt door weloverwogen planning of pijnlijke iteratie.

Begin met het grondig instrumenteren van uw huidige workloads. Begrijp uw huidige gebruikspatronen, vereisten voor gegevensverplaatsing en compliancebeperkingen voordat u investeringen doet in infrastructuur.

De organisaties die ML met succes opschalen, behandelen infrastructuur als een strategische mogelijkheid, niet als een aankoopoefening. Ze bouwen platforms die meegroeien met hun ML-volwassenheid in plaats van zich vast te leggen in architecturen die beperkingen worden.

Als uw organisatie deze infrastructurele beslissingen moet nemen, werkt Bizonbyte samen met Europese bedrijven om ML-platforms te ontwerpen die prestaties, kosten en compliance in balans brengen. De juiste architectuur hangt af van uw specifieke context, niet van het marketingmateriaal van de leverancier.